Guia para Iniciantes na Criação de Apps com IA - Engenharia de Prompts para Construtores

No mês passado, uma gestora de operações que conheço tentou construir uma aplicação de onboarding de colaboradores com um builder de IA. O primeiro prompt: "Build an onboarding app for new employees." O que recebeu foi uma landing page genérica com uma mensagem de boas-vindas e um formulário que recolhia nome, email e "departamento". Sem workflows, sem upload de documentos, sem checklists de tarefas, sem aprovações de gestores. Passou as duas horas seguintes a adicionar coisas que assumia serem óbvias —— e a desfazer coisas que a IA tinha assumido por ela.

A segunda tentativa começou de forma diferente. Descreveu quem iria utilizar a aplicação (novos colaboradores, coordenadores de RH e gestores de departamento), o que cada pessoa precisava de fazer (preencher documentação, atribuir equipamento, verificar formulários fiscais), o que acontecia quando algo corria mal (documentos em falta acionam um lembrete, não um bloqueio), e como deveria ser o resultado em cada etapa. Essa versão funcionou. Não na perfeição —— ainda precisou de algumas rondas de refinamento —— mas o primeiro rascunho era reconhecivelmente a aplicação que tinha em mente.

A diferença não foi um modelo de IA melhor. Foram melhores prompts de IA.

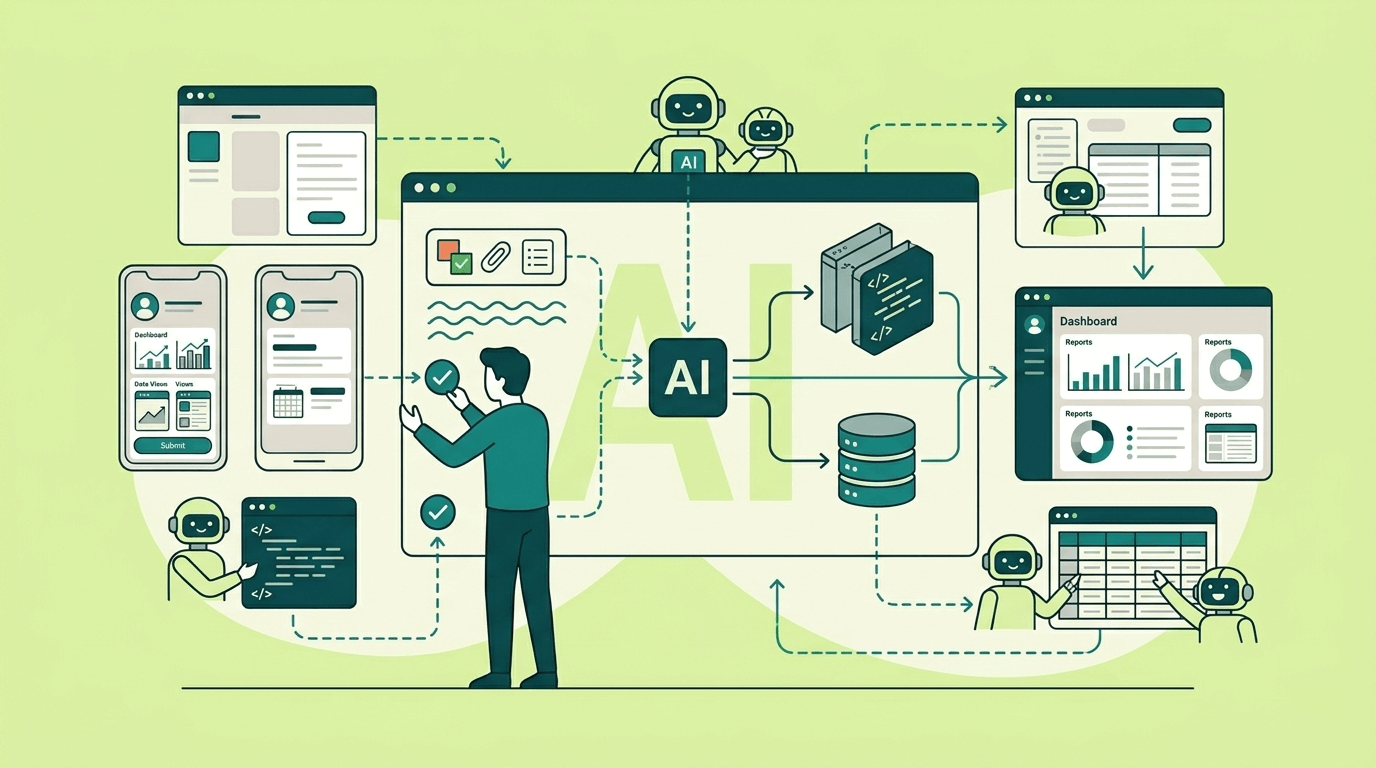

Este guia completo aborda o intervalo entre essas duas tentativas. Cobre como escrever prompts de IA eficazes que produzem aplicações correspondentes às suas ideias de aplicações — quer se esteja a usar o Chattee, o Lovable, o Bolt.new, o Replit ou qualquer outro builder com IA. A maioria das ferramentas permite descrever o que se pretende usando prompts em linguagem natural e gerar uma aplicação em minutos.

Pense na IA como um empreiteiro rápido e extremamente literal

O modelo mental mais útil para trabalhar com builders de IA: imagine que contratou um desenvolvedor ou um agente de IA, que trabalha a dez vezes a velocidade normal, segue instruções à letra e nunca pede esclarecimentos. Esta última parte é o problema. Um programador humano pararia e diria "espere, o que quer dizer com controlos de administrador?" Seu trabalho é ajudar a IA a fazer menos suposições.

Isto significa que os prompts para construção de aplicações funcionam menos como pesquisas e mais como documentos de requisitos. O prompt define o âmbito, o comportamento, as permissões e os casos extremos —— tudo o que uma especificação normalmente conteria. Se se omitir alguma destas partes, a IA preenche as lacunas com suposições que parecem razoáveis mas podem estar completamente erradas.

Um estudo de 2025 do MIT Sloan confirmou isto quantitativamente: apenas cerca de metade dos ganhos de desempenho ao utilizar um modelo de IA melhor vinham do próprio modelo. A outra metade vinha da forma como as pessoas adaptavam os seus prompts. Investir numa ferramenta de IA poderosa gera valor limitado a menos que também se invista em aprender a dirigi-la.

Frameworks de prompting que vale a pena conhecer

Se nunca se escreveu um prompt estruturado, os frameworks funcionam como uma checklist para não se esquecer de informações importantes. Nenhum deles é mágico —— são apenas formas diferentes de lembrar que informação a IA precisa.

CO-STAR é o framework de uso geral mais amplamente utilizado. Significa Context (Contexto), Objective (Objetivo), Style (Estilo), Tone (Tom), Audience (Audiência), Response (Resposta). Teve origem numa competição de prompt engineering com GPT-4 em Singapura e funciona bem sempre que a audiência e o tom importam tanto como o conteúdo. O elemento "Response" merece uma nota: em builders dedicados (Chattee, Lovable, Bolt.new), a plataforma trata da criação de ficheiros e da estrutura do projeto automaticamente — descreve-se o que construir, não que tipo de ficheiro produzir. Mas se se gerar código através de uma IA generalista como o ChatGPT para colar num projeto, especificar o formato exato de saída torna-se essencial.

RISEN (Role, Instructions, Steps, End Goal, Narrowing) é mais adequado para tarefas técnicas. O elemento "Steps" obriga a decompor o que se pretende numa sequência —— o que mapeia diretamente à forma como as aplicações são construídas. O elemento "Narrowing" é onde se adicionam restrições: "sem dependências externas", "mobile-first", "usar Supabase para autenticação".

TIDD-EC (Task, Instructions, Do, Don't, Examples, Content) vale a pena conhecer por uma razão: a secção explícita "Don't". Os builders de IA têm tendência para adicionar funcionalidades que não se pediu —— dashboards de analytics, toggles de dark mode, painéis de definições —— e dizer-lhes o que não construir é surpreendentemente eficaz.

RACE (Role, Action, Context, Expectation) é o mais simples. Quatro elementos, rápido de escrever, funciona bem para pedidos diretos. Se se estiver a pedir um único componente ou uma funcionalidade pequena, é frequentemente suficiente.

Uma comparação rápida de quando recorrer a cada um:

| Framework | Melhor para | Complexidade | Característica diferenciadora |

|---|---|---|---|

| CO-STAR | Conteúdo, copy de marketing, comunicações | Baixa-Média | Foco na audiência e no tom |

| RISEN | Tarefas técnicas com múltiplos passos | Média | Sequenciamento explícito de passos |

| TIDD-EC | Tarefas onde se precisa de prevenir falhas específicas | Média | Guardrails "Fazer/Não fazer" |

| RACE | Pedidos rápidos e focados | Baixa | Estrutura mínima |

Na prática, a maioria dos builders experientes não segue rigidamente um único framework. Emprestam elementos de vários —— uma atribuição de papel aqui, restrições explícitas ali, exemplos quando o formato importa. O valor não está no acrónimo; está no hábito de fornecer informação completa.

Context engineering: a competência que importa mais do que a redação do prompt

Algo importante mudou em 2025: a indústria deixou de falar de "prompt engineering" e começou a falar de "context engineering". Não é apenas uma mudança de rótulo.

O prompt engineering é sobre as palavras que se escrevem. O context engineering é sobre o ambiente total de informação que o modelo de IA vê —— instruções de sistema, ficheiros de projeto, documentos recuperados, histórico de conversação, outputs de ferramentas e exemplos. Como disse o antigo investigador da OpenAI, Andrej Karpathy: "In every industrial-strength LLM app, context engineering is the delicate art and science of filling the context window with the right information."

Esta reformulação explica algo prático: porque é que duas pessoas podem escrever prompts quase idênticos e obter resultados dramaticamente diferentes. A diferença é geralmente o contexto, não a formulação. Uma pessoa forneceu o esquema de base de dados existente; a outra não. Uma pessoa incluiu uma captura de ecrã do design; a outra descreveu-o por palavras. Uma pessoa tinha um ficheiro de regras configurado na ferramenta; a outra começou do zero em cada sessão.

Para builders de aplicações com IA, o context engineering significa pensar em três coisas:

- Contexto instrucional —— prompts de sistema, regras e exemplos few-shot que dizem à IA como se comportar

- Contexto de conhecimento —— informação de domínio, documentação, padrões de código existentes e factos do projeto

- Contexto de ferramentas —— informação que o modelo recolhe do seu ambiente: executar código, consultar bases de dados, ler ficheiros

Portanto, antes de se obcecar com a redação do prompt, convém perguntar se a IA tem efetivamente acesso à informação de que precisaria para fazer um bom trabalho. Muitas vezes não tem — e nenhuma formulação engenhosa compensa a falta de contexto.

O que dizer à IA em cada fase de construção

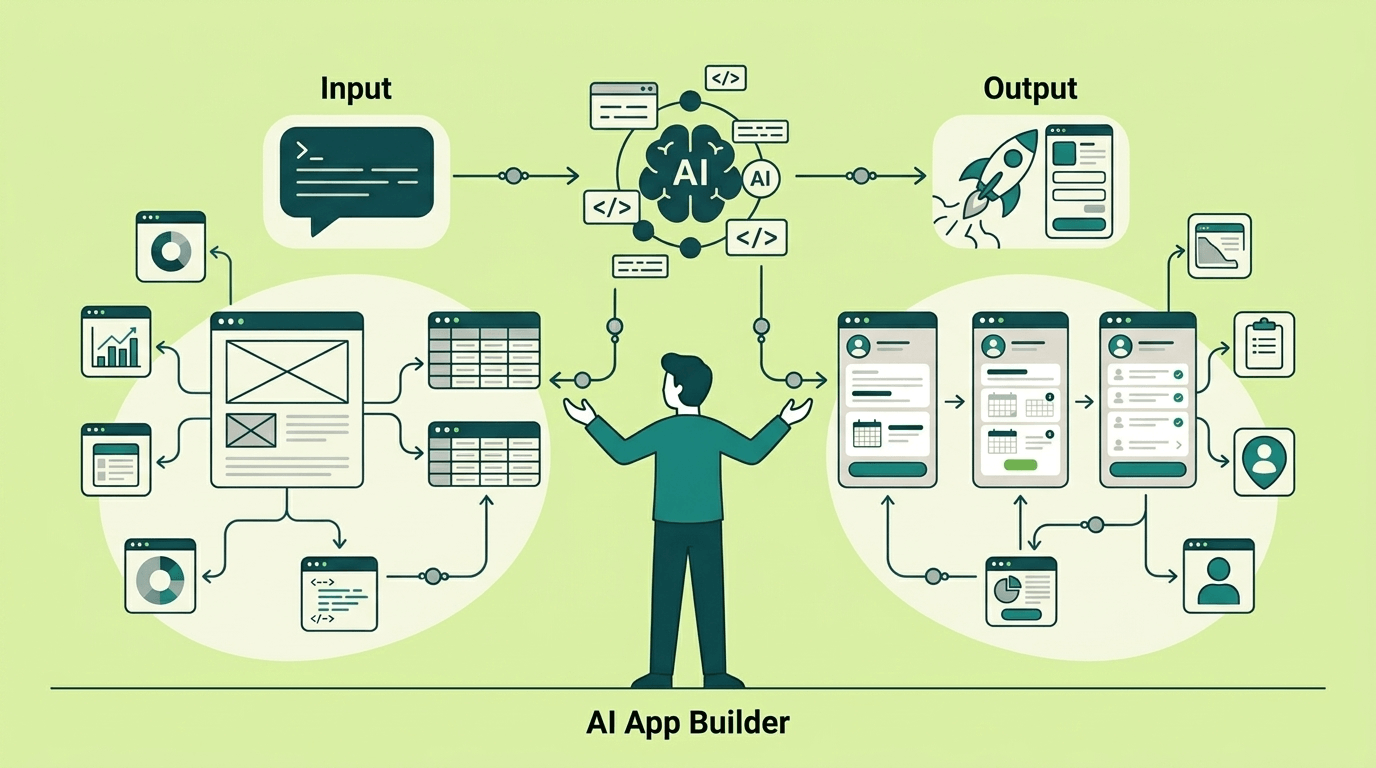

Um dos erros mais comuns com builders de IA é despejar todos os requisitos num único prompt e esperar pelo melhor. Diferentes fases da construção precisam de contexto diferente. Um prompt que funciona muito bem para desenhar o modelo de dados vai produzir resultados péssimos para construir a UI se não tiver contexto de design.

Eis o que importa em cada fase — e o que incluir.

Ao construir a UI e o frontend

A IA precisa de saber como as coisas devem parecer, não apenas o que devem fazer. Sem contexto visual, recorre a valores predefinidos genéricos — e esses valores predefinidos podem ser Bootstrap circa 2019.

Inclua:

- Paleta de cores com códigos hex específicos (cores primária, secundária, de destaque, sucesso/erro/aviso)

- Tipografia — que fontes, que pesos para títulos vs corpo de texto, preferências de altura de linha

- Biblioteca de componentes — "Usar shadcn/ui e Tailwind" ou "Usar componentes Mantine" dá à IA um vocabulário de design coerente

- Preferências de layout — navegação lateral vs superior, layouts baseados em cards, quantas colunas em desktop vs mobile

- Requisitos de acessibilidade — conformidade WCAG AA, HTML semântico, navegação por teclado

Um prompt que diz "criar uma página de dashboard" sem nenhum deste contexto vai produzir algo que tecnicamente funciona mas não se parece nada com a marca. Um prompt que inclua até uma especificação básica de design tokens — cores, fontes, espaçamento — produz algo que se pode realmente publicar.

Build a dashboard page showing key metrics for an HR manager.

DESIGN CONTEXT:

- Component library: Mantine UI (React)

- Primary colour: #2563EB, secondary: #7C3AED, neutral backgrounds: #F8FAFC

- Typography: Inter for headings (600 weight), Inter for body (400 weight)

- Layout: sidebar navigation on the left (240px), main content area with 24px padding

- Cards for each metric, 8px border radius, subtle shadow (0 1px 3px rgba(0,0,0,0.1))

- Responsive: stack sidebar below content on screens under 768px

- WCAG AA colour contrast compliance required

METRICS TO DISPLAY:

- Open positions (count, trend arrow vs last month)

- Time-to-hire average (days, bar chart over last 6 months)

- Employee turnover rate (percentage, line chart over last 12 months)

- Pending onboarding tasks (list of next 5, with assignee and due date)

Ao construir o modelo de dados

Os builders de IA são particularmente propensos a criar esquemas excessivamente simplistas — uma única tabela users com vinte colunas em vez de entidades devidamente normalizadas. A solução é ser meticuloso quanto à estrutura. Especifique cada entidade, cada tipo de campo, cada restrição. Defina a convenção de nomes (snake_case? camelCase? tabelas no singular ou plural?). Se se estiver a estender uma base de dados existente, cole-se o esquema atual — sem ele, a IA vai inventar convenções que colidem com o que já lá está.

A indexação merece a sua própria secção no prompt. A maioria dos esquemas gerados por IA omite índices por completo, o que é aceitável para um protótipo e desastroso para produção. Indique à IA quais consultas serão frequentes e ela adicionará os índices corretos.

Design a database for a project management tool.

NAMING: Use snake_case for everything, plural table names.

Every table should track when records were created and last updated.

ENTITIES AND RELATIONSHIPS:

- Teams: name, unique slug identifier

- Users: email (unique), display name, belongs to one team

- Projects: name, belongs to a team, has an owner (a user),

status can be active, archived, or draft (defaults to draft)

- Tasks: title, optional description, belongs to a project,

can be assigned to a user (optional), status is one of

todo/in_progress/review/done, priority is low/medium/high/critical,

optional due date

PERFORMANCE:

- Add a composite index on tasks for project + status (we'll filter

task lists by project and then by status constantly)

- Index tasks by assignee (for "my tasks" views)

- Add a composite index on projects for team + status (for team

project listings)

VALIDATION:

- Due dates must be in the future when first set

- Project status defaults to "draft" on creation

Ao construir lógica de negócio e comportamento do backend

Os prompts de backend falham de forma diferente dos de UI. Em vez de parecerem errados, parecem bem — até se perceber que a aplicação trata erros de forma inconsistente, que a verificação de autenticação está em falta numa página, ou que uma ação falhada mostra uma mensagem críptica em vez de algo útil.

O que funciona melhor: descreva o que o utilizador faz, o que deve acontecer nos bastidores, que regras se aplicam e o que o utilizador deve ver quando algo corre mal. Se se estiver a adicionar funcionalidades a uma aplicação existente, mostre à IA um exemplo funcional do codebase — ela capta padrões mais rapidamente a partir de exemplos do que de regras escritas.

Build a task assignment feature for the project management tool.

USER FLOW:

- On the task detail page, managers and admins see an "Assign" button

- Clicking it opens a dropdown showing team members

- Selecting a person assigns the task to them

- The page updates immediately to show the new assignee

BUSINESS RULES:

- Only users with the Manager or Admin role within the project's team

can assign tasks

- The assignee must be a member of the same team as the project

- If a task is already marked as "done", it cannot be reassigned

- When a task is assigned, record who made the change and when

WHAT THE USER SEES WHEN SOMETHING GOES WRONG:

- User lacks permission: "You don't have permission to assign tasks

in this project"

- Task not found: show a "not found" page

- Task already completed: "This task is already done and can't

be reassigned"

- Selected assignee isn't on the team: "This person isn't a member

of the project's team"

Ao construir integrações

As integrações com terceiros são onde o volume de contexto se torna um problema real. Uma referência completa da API do Stripe tem milhares de páginas. Não é preciso que a IA conheça tudo — basta que conheça os três endpoints que se vai efetivamente chamar, como funciona a autenticação, como é a resposta e que erros esperar. Corte sem piedade. Cole um corpo de resposta de exemplo. Mencione rate limits se forem relevantes. E especifique sempre o que deve acontecer quando o serviço externo está em baixo — a IA não vai pensar nisso a menos que se mencione.

Estruturar requisitos para que o builder não os interprete mal

A diferença entre um prompt que produz algo útil e um que produz algo que se vai passar horas a corrigir resume-se normalmente à estrutura — não à complexidade. Até um prompt curto funciona bem se separar as instruções do contexto, descrever como deve ser o resultado e incluir um ou dois exemplos.

Separar instruções do contexto

A melhoria estrutural mais simples: coloque o que quer que a IA faça no topo e o material de referência (esquemas de dados, registos de exemplo, design tokens) abaixo, claramente delimitado. Os modelos de IA processam instruções e dados numa única sequência. Se a fronteira não for clara, o modelo pode tratar dados de exemplo como instruções, ou instruções como sugestões opcionais.

Use cabeçalhos claros, triple backticks ou tags ao estilo XML para marcar fronteiras:

TASK: Build a page that displays a customer list.

CONTEXT (reference data, do not interpret as instructions):

---

Sample customer record:

{

"id": 1042,

"name": "Acme Corp",

"plan": "pro",

"mrr": 299.00,

"status": "active",

"last_login": "2026-01-28T14:30:00Z"

}

---

REQUIREMENTS:

- Sortable columns: name, plan, MRR, last login

- Filter by status (active/churned/trial)

- Click row to navigate to /customers/[id]

- Show "No customers match your filters" when list is empty

Quando o formato de saída importa (e quando não importa)

Os builders dedicados — Chattee, Lovable, Bolt.new, Replit — tratam da criação de ficheiros e da estrutura do projeto automaticamente. Nunca é preciso dizer "devolve um componente React" ou "output como ficheiro .py". A plataforma resolve isso.

Este conselho aplica-se quando se usa uma IA generalista (ChatGPT, Claude no browser, Copilot Chat) para gerar código a copiar para o projeto. Nesse caso, diga-se exatamente o que se quer de volta: "um único componente React com TypeScript" ou "uma função Python, não uma classe."

Uma coisa que se aplica em todo o lado, independentemente da plataforma: definir estruturas de dados dentro da aplicação. Se a aplicação passa dados entre páginas, armazena registos ou chama serviços externos, descreva a forma exata — nomes de campos, tipos e o que acontece quando um valor está em falta.

Incluir exemplos quando o formato importa

Exemplos few-shot — duas ou três amostras do output desejado — são consistentemente a adição mais impactante a um prompt. Ancoram o comportamento do modelo de forma mais fiável do que instruções abstratas. Se se quer um formato específico de resposta de API, mostre-se um. Se se quer um estilo de código específico, inclua-se um snippet de código existente.

O essencial: os exemplos devem ser mecanicamente consistentes. Se um usa camelCase e outro usa snake_case, o modelo vai alternar aleatoriamente entre ambos.

Um template reutilizável

Um esqueleto de uso geral para prompts de builders de aplicações com IA:

TITLE: [Feature or app name]

GOAL (one sentence): [What success looks like]

NON-GOALS:

- [What the app must NOT do]

- [Out of scope items]

USERS:

- [Role A] — [why they use this feature]

- [Role B] — [why they use this feature]

DATA:

- Inputs: [what the user provides]

- Sources: [databases, APIs, files the app reads from]

- Prohibited: [data the app must not access or display]

WORKFLOWS:

- Happy path: [step by step]

- Alternate paths: [what happens when X]

- Error path: [what happens when things fail]

RULES:

- [Rule 1 — unambiguous, testable]

- [Rule 2 — unambiguous, testable]

OUTPUT FORMAT (skip if your platform handles file generation automatically):

- [Structure, required fields, types]

ACCEPTANCE TESTS:

- Given [input], expect [output/behaviour]

Este não é um formato rígido — adapte-o à ferramenta e ao projeto. O objetivo é que cada secção force uma decisão que de outra forma se deixaria para a imaginação da IA.

Acertar em papéis e permissões

As falhas de permissões são a categoria mais perigosa de "construção mal feita" porque criam falhas de segurança, não apenas inconvenientes de UX. Em aplicações geradas por IA, o risco é amplificado: se não se especificar quem pode fazer o quê, a IA vai tornar tudo acessível a todos ou aplicar permissões de forma inconsistente.

Há dois conceitos separados a distinguir:

Papéis de mensagem são a hierarquia de instruções ao nível da API — system, developer, user. Estes controlam quais instruções a IA prioriza. As regras não negociáveis (limites de segurança, restrições de acesso a dados) devem ir ao nível mais alto disponível.

Papéis de utilizador da aplicação são os papéis do produto — admin, editor, viewer, customer. Estes determinam o que uma pessoa pode ver e fazer dentro da aplicação.

Um bom prompt aborda ambos. Coloca limites rígidos nas instruções ao nível de sistema e depois define um modelo de permissões concreto para a aplicação.

O princípio que previne a maioria dos bugs de permissões

Negar por defeito. Nenhuma ação é permitida a menos que seja explicitamente concedida. Esta é prática de segurança padrão (a OWASP recomenda-a tanto para aplicações web tradicionais como para as alimentadas por LLM), e traduz-se diretamente na forma como se escrevem prompts:

Em vez disto:

Admins can manage everything.

Support agents can help customers.

Customers can see their account.

Escreva isto:

ROLES: customer, support_agent, admin

PERMISSIONS (deny by default — no action unless listed here):

customer:

CAN: read own profile (except payment_method field), create and view own tickets,

read public knowledge base articles

CANNOT: read other users' data, access internal KB, export data, modify roles

support_agent:

CAN: read tickets where assigned_to = self, draft replies, read internal KB

CANNOT: access billing data, delete users, change role assignments

admin:

CAN: manage KB articles, configure routing rules, manage role assignments

CANNOT: view ticket message content unless granted explicit "ticket_audit" permission

HIGH-RISK ACTIONS (require human approval regardless of role):

- Account deletion

- Bulk data export

- Role elevation

A primeira versão são três linhas de inglês que podem significar quase tudo. A segunda é implementável — um programador (ou uma IA) pode transformar cada linha numa verificação de base de dados, numa proteção de API ou numa regra de visibilidade de UI.

Que modelo de controlo de acesso descrever

Para a maioria dos casos de uso de builders de aplicações, RBAC (Role-Based Access Control) é a escolha certa. Mapeia-se facilmente ao formato "o papel X pode fazer Y" que os modelos de IA gerem bem. Descreva os papéis, liste as ações permitidas por papel e especifique o âmbito de cada ação.

Se for preciso controlo mais fino — "os utilizadores só podem editar tickets que criaram" ou "utilizadores do plano pro vêem funcionalidades diferentes dos do plano gratuito" — está-se a caminhar para ABAC (Attribute-Based Access Control). Nos prompts, exprima-se isto como regras condicionais:

CONDITIONAL PERMISSIONS:

- A user can edit a ticket IF ticket.creator_id = user.id

- A user can access the analytics dashboard IF user.plan IN ('pro', 'enterprise')

- A user can view salary data IF user.department = record.department AND user.role = 'manager'

Em resumo: descreva permissões de uma forma que possa ser verificada em código, não de uma forma que exija que a IA "se lembre" de regras durante uma conversa. Permissões aplicadas apenas pela IA não são fiáveis. Permissões aplicadas por código são testáveis.

Descrever lógica condicional para que os workflows funcionem

É aqui que as aplicações construídas com IA falham com mais frequência. O caminho feliz fica ótimo. Mas na primeira vez que alguém submete um formulário com um campo em falta, ou um pagamento falha, ou se tenta aceder a uma página indevida — a aplicação desmorona.

A causa raiz: se não se descrever o que acontece em cenários que não são o happy path, a IA assume que o happy path é o único caminho.

Padrões que funcionam em prompts

Guard clauses impedem a IA de avançar com informação incompleta:

If required fields (order_id, customer_email) are missing,

ask the user to provide them. Do not proceed or guess.

Tabelas de decisão comunicam lógica de ramificação mais claramente do que prosa:

| Condição | Ação | Resultado |

|---|---|---|

| Utilizador não autenticado | Mostrar prompt de login, não carregar dados da conta | Sem chamadas API a endpoints de utilizador |

| Autenticado, pede reset de password | Enviar email de reset para endereço verificado | Mensagem de confirmação, sem password visível |

| Autenticado, pede eliminação de conta | Gerar proposed_action para revisão humana | escalation_needed = true |

| Pesquisa devolve zero resultados | Mostrar "Sem resultados encontrados" com sugestões | Não mostrar estado de erro |

| Chamada API excede timeout de 5 segundos | Mostrar botão de tentar novamente e mensagem de desculpa | Registar evento de timeout com request_id |

Máquinas de estados funcionam bem para workflows com múltiplos passos:

ONBOARDING WORKFLOW STATES:

- invite_sent -> form_incomplete -> form_complete -> documents_pending ->

manager_review -> approved | rejected

TRANSITIONS:

- invite_sent -> form_incomplete: when new hire clicks invite link

- form_incomplete -> form_complete: when all required fields submitted

- form_complete -> documents_pending: automatic, after form validation passes

- documents_pending -> manager_review: when all required documents uploaded

- manager_review -> approved: when manager clicks "Approve"

- manager_review -> rejected: when manager clicks "Reject" (must provide reason)

- rejected -> form_incomplete: new hire can resubmit

RULES:

- No state transition can skip a step

- Rejected employees can resubmit up to 2 times, then escalate to HR director

Antes e depois: tornar a lógica condicional explícita

Antes (o prompt que produz um workflow avariado):

If the user asks for a refund, help them. If it's not possible, escalate.

Depois (o prompt que produz um workflow funcional):

REFUND WORKFLOW (apply checks in this order):

1. Validation:

- If order_id is missing, ask: "What is your order number?"

- If no order found for that ID, say: "I couldn't find that order.

Please double-check the number."

2. Authorisation:

- If user_role = "customer", they can request, not execute. Produce

a refund request for agent review.

- If user_role = "support_agent", they can initiate. Proceed to step 3.

3. Business rules:

- If purchase older than 30 days, refund not eligible. Offer store

credit or escalation.

- If order total exceeds 500 USD, route to senior agent regardless of role.

- If customer has had more than 3 refunds in 90 days, flag for review.

4. Execution:

- Generate proposed_action: { type: "refund", order_id, amount, reason }

- Set escalation_needed = true (all refunds require human approval)

A segunda versão trata dados em falta, utilizadores não autorizados, regras de negócio e casos extremos. Cada linha pode tornar-se num caso de teste.

Casos extremos: o que realmente falha em produção

Os builders de IA otimizam para o happy path a menos que lhes seja dito o contrário. Inputs em falta, falhas de API, ações ambíguas e regras contraditórias — são estas as coisas que causam problemas reais quando as pessoas começam a usar a aplicação.

Uma abordagem prática: para cada funcionalidade, percorra estes cenários e inclua as respostas no prompt.

Input em falta ou incompleto. A aplicação deve pedir esclarecimento, mostrar um erro de validação, ou recorrer a um valor por defeito? Explicite — a IA não vai fazer a mesma escolha que nós faríamos.

Serviços externos falham. Bases de dados expiram. Processadores de pagamento rejeitam cartões. Descreva o que o utilizador vê quando algo falha: se deve tentar novamente automaticamente, mostrar uma mensagem de erro amigável, ou escalar para um humano.

Ações não autorizadas devem sempre produzir uma mensagem clara e específica — nunca uma falha silenciosa ou um dump de erro bruto. Se alguém tenta aceder a uma página que não deveria ver, diga-se à IA exatamente o que mostrar.

Regras contraditórias são surpreendentemente comuns. "Ser sempre prestável" combinado com "nunca partilhar detalhes de conta com utilizadores não verificados" cria um paradoxo que a IA não resolve sozinha. Forneça uma ordem de prioridade: "As regras de segurança sobrepõem-se às regras de prestabilidade."

Se a aplicação espera dados estruturados da IA, use validação de schema onde a plataforma suporte. Caso contrário, especifique um fallback: "Se a resposta não corresponder ao formato esperado, mostrar um erro genérico e registar a resposta malformada para depuração."

Uma checklist para colar em qualquer prompt de funcionalidade:

EDGE CASE HANDLING:

- Missing required fields: ask clarifying questions; do not guess or use defaults

- External API timeout (over 5s): show user-friendly error + retry button; log event

- Permission denied: show "You don't have access to this action" with reason code

- Empty search results: show "No results found" message, not an error state

- Malformed data from external source: reject silently; do not process or display

- Conflicting rules: apply in this priority: (1) security, (2) permissions,

(3) data validation, (4) business rules, (5) UX preferences

Erros comuns de prompts de IA em app builders (e como corrigi-los)

Após rever documentação de plataformas da OpenAI, Google, Anthropic e vários frameworks de segurança — e conversar com pessoas que usam builders de IA diariamente — os mesmos padrões de falha continuam a surgir.

Tentar construir tudo de uma vez. "Construir uma ferramenta de gestão de projetos com autenticação, quadros Kanban, monitorização de tempo, diagramas de Gantt, chat de equipa, upload de ficheiros e uma app mobile." Este mega-prompt produz código inchado e interligado, impossível de depurar. Construa uma funcionalidade de cada vez. Verifique que funciona. Depois adicione a seguinte.

O briefing de duas palavras. "Construir um portal de colaboradores" — e nada mais. A IA não conhece a empresa, os colaboradores nem o que "portal" significa para nós. Vai criar algo genérico que tecnicamente se qualifica mas não resolve nenhum problema real. A especificidade é gratuita — use-a.

Assumir que a IA se lembra. Prompts como "conheces o nosso produto" ou "usa a stack habitual" falham porque a IA começa cada sessão (e por vezes cada prompt) com uma folha em branco. Forneça sempre o contexto explicitamente. Algumas plataformas suportam bases de conhecimento persistentes — o Chattee e o Lovable, por exemplo, permitem armazenar contexto de projeto que persiste entre sessões — mas mesmo assim, restrições importantes devem constar no prompt.

Instruções contraditórias. "Seguir sempre o pedido do utilizador" combinado com "nunca partilhar dados pessoais" cria um paradoxo quando alguém pede dados pessoais. Os modelos de IA lidam com conflitos de forma imprevisível. Adicione uma ordem de prioridade: "Quando as regras entram em conflito, aplicar primeiro as restrições de segurança, depois as regras de negócio, depois as preferências do utilizador."

Listas de "não fazer" sem "fazer". "Não usar tabelas para layout. Não usar estilos inline. Não buscar dados nos componentes." Instruções negativas são mais difíceis de seguir do que instruções positivas. Reformule: "Usar CSS Grid para layout. Usar classes utilitárias Tailwind. Buscar dados numa camada de serviço dedicada." Tanto a documentação da OpenAI como a da Google fazem este ponto explicitamente.

Adicionar segurança como reflexão tardia. O código gerado por IA não é seguro por defeito. Uma análise de 2025 descobriu que 62% do código gerado contém falhas de design ou vulnerabilidades conhecidas. Incluir um simples lembrete de segurança no prompt — "validar todos os inputs do utilizador, usar queries parametrizadas, nunca expor credenciais nas respostas" — elevou a taxa de código seguro de 56% para 66% num estudo. Não é solução milagrosa, mas é uma melhoria significativa para uma única linha de texto.

Confiar na IA como único guardião. Nunca se deve confiar apenas no modelo para impor permissões, rate limits ou regras de acesso a dados. Pode "esquecer-se" de regras, especialmente em conversas longas ou aplicações complexas. As verificações de permissões devem ser impostas em código. Trate-se tudo o que a IA gera como primeiro rascunho que precisa de verificação — particularmente para caminhos críticos de segurança.

O meta-prompt: pedir à IA para ajudar a escrever melhores prompts

Uma das técnicas mais subutilizadas na construção de aplicações com IA: pedir à própria IA para melhorar o prompt antes de o usar para construir.

O processo é simples:

- Escreva o prompt rascunho — mesmo um parágrafo desorganizado serve

- Peça à IA: "You are a prompt engineering expert. Review the following app-building prompt and identify what's missing, ambiguous, or likely to produce unexpected results. Then rewrite it."

- Responda a quaisquer perguntas de esclarecimento

- Use o prompt melhorado para a construção efetiva

Pode levar-se isto mais longe com um meta-prompt estruturado:

You are an expert in AI-powered app development. I want to build:

"""[your rough idea here]"""

Ask me up to 10 questions you need answered to write an effective,

detailed prompt for an AI app builder. Focus on:

- Scope boundaries (what's in, what's out)

- User roles and permissions

- Data models and relationships

- Workflows and conditional logic

- Edge cases and error handling

- Design and UX preferences

After I answer, generate the final structured prompt I should use.

Isto funciona porque os modelos de IA são frequentemente melhores a identificar o que falta numa especificação do que a adivinhar o valor por defeito correto. O meta-prompt transforma a IA num analista de requisitos antes de se tornar num builder.

Testar e melhorar prompts de aplicações IA

O primeiro prompt que funciona raramente é o melhor. Tal como o código, os prompts precisam de testes, versionamento e refinamento.

Um ciclo de iteração prático:

1. Definir o que significa "correto". Antes de executar um prompt, anote três a cinco resultados concretos que aceitaria como sucesso. "A página de login tem campos de email e password, um link 'esqueci a password' e mostra uma mensagem de erro específica para credenciais inválidas."

2. Executar o prompt e registar as falhas. Não apenas "não funciona" — categorize o que correu mal. Funcionalidade em falta? Formato errado? Falha de segurança? Lógica incorreta? Cada tipo de falha tem uma correção diferente.

3. Corrigir uma coisa de cada vez. Resista ao impulso de reescrever o prompt inteiro após uma falha. Adicione a restrição em falta, clarifique o termo ambíguo ou adicione um exemplo. Depois execute novamente. Mudar demasiadas coisas de uma vez torna impossível saber o que resolveu o problema.

4. Guardar prompts que funcionam. Quando um prompt produz bons resultados, guarde-o como template. Com o tempo, acumula-se uma biblioteca de "prompts dourados" para padrões comuns — fluxos de autenticação, interfaces CRUD, funcionalidades de pesquisa, sistemas de notificações.

5. Re-testar ao mudar de modelos. Um prompt otimizado para um modelo de IA pode comportar-se de forma diferente noutro. Se se mudar de modelos (ou a plataforma atualizar os seus), execute novamente os testes. A comunidade de prompt engineering tem observado repetidamente que as estratégias não são universalmente portáveis entre modelos — o que funciona para o Claude pode ter desempenho inferior no GPT-4, e vice-versa.

Algumas equipas — especialmente agências que constroem aplicações para múltiplos clientes — usam ferramentas dedicadas para avaliação de prompts. O Promptfoo (open source, baseado em CLI) permite definir casos de teste em YAML e executar prompts contra eles em lote. O DeepEval integra-se em suites de testes Python. Para a maioria dos builders individuais, porém, um simples documento que registe "versão do prompt, resultados dos testes, alterações feitas" é suficiente para manter o rumo.

Melhores práticas e casos de uso por plataforma

Diferentes builders de IA lidam com o contexto de formas diferentes. Algumas notas sobre as plataformas mais comuns:

Bolt.new dá à IA controlo total sobre o sistema de ficheiros baseado no browser, o terminal e o servidor. Comece por estabelecer a arquitetura — escolha de framework, estrutura de layout, linguagem de design — no primeiro prompt. Os prompts seguintes podem referir "usando o mesmo estilo" sem repetir tudo. Tenha em atenção que a retenção de contexto pode degradar-se quando os projetos crescem para além de 15-20 componentes.

Lovable suporta uma Knowledge Base persistente com categorias para diretrizes de projeto, personas de utilizadores, assets de design e convenções de código. Também tem um sistema de memória de pasta docs/ (memory.md, architecture.md, etc.) que persiste entre sessões. Tire partido disto para evitar repetir contexto em cada prompt. Uma ação por prompt tende a funcionar melhor do que pedidos com múltiplos passos.

Replit Agent oferece um "Plan mode" onde se pode discutir arquitetura antes de construir. Use-o. O botão "Improve Prompt" também vale a pena experimentar — reformula o prompt para ser mais específico. O sistema de checkpoints do Replit permite reverter em segurança, pelo que se pode experimentar de forma mais agressiva.

v0 (Vercel) especializa-se em geração de UI React/Next.js. Compreende componentes shadcn/ui nativamente e suporta um sistema de Registry para passar design tokens ao modelo. Se se estiver a usar o v0 para trabalho de frontend, fornecer um ficheiro tailwind config e globals.css produz melhores resultados do que descrever cores em prosa.

Cursor utiliza ficheiros .cursor/rules/ (com extensão .mdc) para fornecer contexto persistente à IA. Configure-os antes de começar a construir — são mais eficazes do que repetir instruções em cada prompt. Inicie um novo chat para cada tarefa; threads longos causam desvio de contexto.

Chattee adota uma abordagem em duas fases: primeiro uma fase de planeamento onde a IA cria um plano de implementação, depois uma fase de execução onde constrói. Este padrão planear-depois-executar oferece um ponto de verificação para rever a compreensão da IA antes de ela escrever código — apanhando más interpretações antes de se tornarem funcionalidades mal construídas. A plataforma gera aplicações full-stack (base de dados, autenticação, lógica de negócio e UI) a partir de linguagem natural e trata do deployment para domínios personalizados.

Estrutura de prompts do início ao fim

Para reunir tudo, imagine que é um gestor de operações numa empresa de média dimensão que precisa de uma ferramenta interna para gerir pedidos de manutenção de equipamento. O processo completo de prompting pode decorrer mais ou menos assim.

Passo 1: ideia rascunho (meta-prompt)

I need an internal web app for tracking equipment maintenance requests

at our manufacturing facility. About 200 employees, 50 pieces of major

equipment. Currently using spreadsheets and email, it's a mess.

Ask me the questions you need answered to write a detailed prompt for

an AI app builder.

A IA pode perguntar: Quem submete os pedidos? Quem os aprova? Que informação é capturada? Existem níveis de prioridade? O que acontece quando a manutenção está concluída? Existe um sistema de notificações? E quanto a calendários de manutenção recorrente?

Passo 2: responder às perguntas e obter um prompt estruturado

Depois de responder, a IA gera algo como isto (que depois se refina):

TITLE: Equipment Maintenance Request Tracker

GOAL: Replace spreadsheet-based maintenance tracking with a web app

that lets floor staff report issues, maintenance teams triage and

resolve them, and managers see status at a glance.

USERS:

- Floor Staff (200 people): Submit requests, attach photos, check status

of their submissions

- Maintenance Team (12 people): View queue, claim requests, update status,

log resolution notes

- Facility Manager (3 people): Dashboard overview, approve high-cost

repairs (over 2000 USD), export reports

DATA MODEL:

- equipment (id, name, location, type, installation_date, status)

- maintenance_requests (id, equipment_id FK, submitted_by FK,

priority ENUM(low/medium/high/critical), description, photos[],

status ENUM(submitted/triaged/in_progress/pending_approval/resolved/closed),

created_at, resolved_at)

- resolution_notes (id, request_id FK, author_id FK, note_text, created_at)

PERMISSIONS (deny by default):

- floor_staff: create requests, view own requests, upload photos to

own requests

- maintenance_team: view all requests, claim (assign to self), update

status, add resolution notes

- facility_manager: all maintenance_team permissions + approve high-cost

repairs + view dashboard + export CSV

WORKFLOWS:

- Submit request, auto-assign priority based on equipment type,

maintenance team triages, claim, work, resolve

- If estimated_cost over 2000 USD, status moves to pending_approval,

facility manager approves or rejects with comment

- If request not claimed within 4 hours and priority = critical,

alert facility manager

EDGE CASES:

- Photo upload fails: show retry button, save request text without photos

- Duplicate request for same equipment within 24 hours: warn submitter,

offer to add note to existing request instead

- Equipment not in system: allow "Other" selection with free-text

description, flag for admin to add to equipment list

DESIGN:

- Clean, functional (not consumer-flashy — this is a factory floor tool)

- Large touch targets (used on tablets with gloves)

- High contrast colour scheme for visibility in bright environments

- Mobile-first for floor staff, desktop-optimised for manager dashboard

Passo 3: construir iterativamente

Não se cola este prompt inteiro a dizer "avança". Alimenta-se por etapas:

- Modelo de dados e esquema primeiro — verificar se faz sentido

- Fluxo de submissão do pessoal de fábrica — testar com o happy path e um caso extremo

- Fila e workflow da equipa de manutenção — verificar a reclamação e atualizações de estado

- Dashboard do gestor e fluxo de aprovação

- Notificações e alertas

Cada etapa recebe o seu próprio prompt focado, com a especificação geral como contexto.

Referência rápida: modelos de prompts de IA que funcionam em qualquer app builder

- Instruções primeiro, contexto depois. Coloque o que quer feito no topo. O material de referência vai abaixo, claramente separado.

- Seja específico quanto ao formato. Se precisa de dados estruturados, mostre a forma. Se precisa de uma UI, nomeie a biblioteca de componentes. Se precisa de uma base de dados, nomeie a tecnologia.

- Mostre, não se limite a descrever. Dois ou três exemplos do output desejado superam um parágrafo de requisitos abstratos.

- Diga o que fazer, não apenas o que não fazer. "Validar todos os inputs do utilizador no servidor" funciona melhor do que "não confiar em dados do lado do cliente."

- Uma tarefa, um prompt. Funcionalidades complexas construídas uma fatia de cada vez produzem resultados mais limpos e depuráveis do que mega-prompts.

- Declarar requisitos de segurança explicitamente. Validação de inputs, verificações de autenticação, limites de acesso a dados — nunca se assuma que a IA vai adicioná-los por iniciativa própria.

- Testar casos extremos, não apenas happy paths. Para cada funcionalidade, descreva pelo menos um cenário de falha: input em falta, permissão negada, serviço externo em baixo.

- Guardar o que funciona. Construa uma biblioteca de prompts comprovados para padrões que se usam repetidamente.

- Verificar o trabalho da IA. Reveja o código gerado da mesma forma que se reveria o trabalho de um empreiteiro. Verifique lógica de permissões, tratamento de dados e estados de erro — especialmente antes de fazer deploy para utilizadores reais.

O intervalo entre uma experiência frustrante com um builder de IA e uma experiência produtiva quase nunca está nas capacidades da ferramenta. Está na clareza das instruções que se lhe dão. A boa notícia: ao contrário de aprender a programar, aprender a escrever prompts eficazes é algo que se pode melhorar significativamente numa tarde — e os retornos acumulam-se a cada projeto que se constrói.