Guide du débutant pour créer des applications avec l'IA - Prompt Engineering pour les créateurs

Le mois dernier, une responsable des opérations que je connais a essayé de créer une application d'onboarding pour les nouveaux employés avec un constructeur IA. Son premier prompt : "Build an onboarding app for new employees." Ce qu'elle a obtenu en retour était une page d'accueil générique avec un message de bienvenue et un formulaire qui collectait le nom, l'e-mail et le "département". Aucun workflow. Aucun téléchargement de documents. Aucune checklist de tâches. Aucune approbation de manager. Elle a passé les deux heures suivantes à ajouter des choses qu'elle pensait évidentes —— et à défaire des choses que l'IA avait supposées de son propre chef.

Sa deuxième tentative a commencé différemment. Elle a décrit qui utiliserait l'application (nouveaux employés, coordinateurs RH et responsables de département), ce que chaque personne devait faire (remplir les documents, attribuer le matériel, vérifier les formulaires fiscaux), ce qui se passe quand quelque chose ne va pas (les documents manquants déclenchent un rappel, pas un blocage), et à quoi le résultat devrait ressembler à chaque étape. Cette version a fonctionné. Pas parfaitement —— elle a encore eu besoin de quelques cycles d'affinage —— mais la première ébauche était reconnaissablement l'application qu'elle avait en tête.

La différence n'était pas un meilleur modèle IA. C'était un meilleur prompt.

Ce guide complet traite de l'écart entre ces deux tentatives. Il explique comment rédiger des prompts IA efficaces qui transforment vos idées d'applications en réalité —— que vous utilisiez Chattee, Lovable, Bolt.new, Replit ou tout autre constructeur alimenté par l'IA. Les principes sont les mêmes d'une plateforme à l'autre, même si les détails varient.

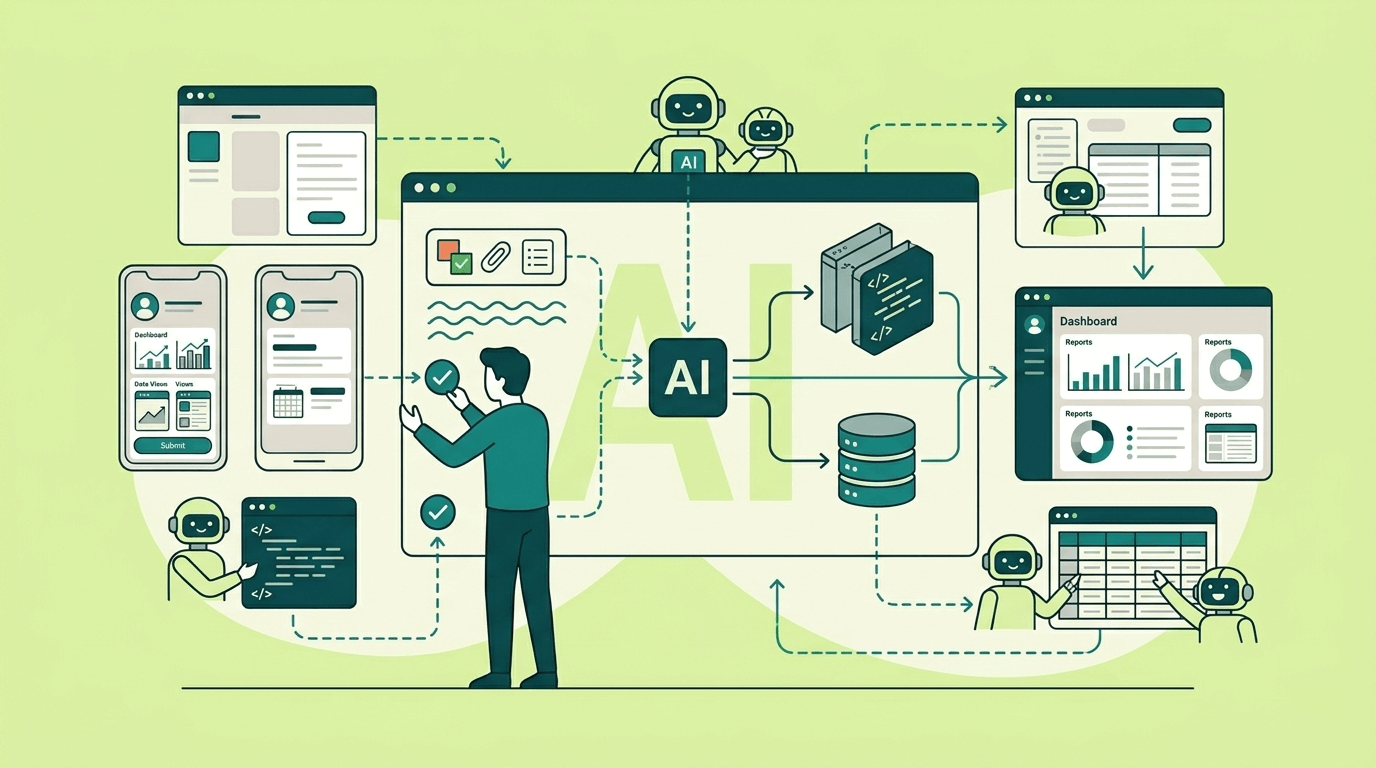

Considérez l'IA comme un prestataire rapide et extrêmement littéral

Le modèle mental le plus utile pour travailler avec les constructeurs IA : imaginez que vous engagez un développeur ou un agent IA qui travaille dix fois plus vite que la normale, suit les instructions à la lettre et ne demande jamais de clarification. Ce dernier point est le problème. Un développeur humain s'arrêterait et dirait "attendez, que voulez-vous dire par contrôles admin ?" Un constructeur IA invente simplement quelque chose. Votre rôle est d'aider l'IA à faire moins d'hypothèses.

Cela signifie que les prompts pour la création d'applications fonctionnent moins comme des requêtes de recherche et plus comme des documents de spécifications. Le prompt définit la portée, le comportement, les permissions et les cas limites —— tout ce qu'un cahier des charges contiendrait normalement. Omettez l'un de ces éléments, et l'IA comble les lacunes avec des suppositions qui semblent raisonnables mais peuvent être complètement erronées pour votre situation.

Une étude du MIT Sloan de 2025 l'a confirmé quantitativement : seulement environ la moitié des gains de performance liés à l'utilisation d'un meilleur modèle IA provenaient du modèle lui-même. L'autre moitié venait de la façon dont les gens adaptaient leurs prompts. Investir dans un outil IA puissant apporte une valeur limitée si vous n'investissez pas également dans l'apprentissage de son pilotage.

Les frameworks de prompting à connaître

Si vous n'avez jamais rédigé de prompt structuré auparavant, les frameworks vous fournissent une checklist pour ne pas oublier les éléments importants. Aucun n'est magique —— ce sont simplement différentes façons de vous rappeler quelles informations l'IA a besoin.

CO-STAR est le framework généraliste le plus largement utilisé. Il signifie Context, Objective, Style, Tone, Audience, Response. Il est né d'une compétition de prompt engineering GPT-4 à Singapour et fonctionne bien pour tout ce où le public et le ton comptent autant que le contenu. L'élément "Response" mérite une note : dans les constructeurs d'applications dédiés (Chattee, Lovable, Bolt.new), la plateforme gère la création de fichiers et la structure du projet automatiquement —— vous décrivez quoi construire, pas quel type de fichier produire. Si toutefois vous générez du code via une IA généraliste comme ChatGPT et que vous le collez dans votre projet, spécifier le format de sortie exact devient essentiel.

RISEN (Role, Instructions, Steps, End Goal, Narrowing) est mieux adapté aux tâches techniques. L'élément "Steps" vous oblige à décomposer ce que vous voulez en une séquence —— ce qui correspond directement à la façon dont les applications sont construites. L'élément "Narrowing" est l'endroit où vous ajoutez des contraintes : "pas de dépendances externes", "mobile-first", "utiliser Supabase pour l'auth."

TIDD-EC (Task, Instructions, Do, Don't, Examples, Content) mérite d'être connu pour une raison : la section "Don't" explicite. Les constructeurs IA ont tendance à ajouter des fonctionnalités que vous n'avez pas demandées —— tableaux de bord analytiques, boutons de mode sombre, panneaux de paramètres —— et leur dire ce qu'ils ne doivent pas construire est étonnamment efficace.

RACE (Role, Action, Context, Expectation) est le plus simple. Quatre éléments, rapide à rédiger, fonctionne bien pour des requêtes simples. Si vous rédigez un prompt pour un seul composant ou une petite fonctionnalité, c'est souvent suffisant.

Un comparatif rapide pour savoir quand utiliser chacun :

| Framework | Idéal pour | Complexité | Caractéristique distinctive |

|---|---|---|---|

| CO-STAR | Contenu, textes marketing, communications | Faible-Moyenne | Focus sur l'audience et le ton |

| RISEN | Tâches techniques multi-étapes | Moyenne | Séquencement explicite des étapes |

| TIDD-EC | Tâches où il faut prévenir des échecs spécifiques | Moyenne | Garde-fous "Do/Don't" |

| RACE | Requêtes rapides et ciblées | Faible | Structure minimale |

En pratique, la plupart des constructeurs expérimentés ne suivent aucun framework de manière rigide. Ils empruntent des éléments à plusieurs —— une attribution de rôle ici, des contraintes explicites là, des exemples quand la mise en forme compte. La valeur n'est pas dans l'acronyme ; elle est dans l'habitude de fournir des informations complètes.

L'ingénierie de contexte : la compétence qui compte plus que la formulation du prompt

Quelque chose d'important a changé en 2025 : l'industrie a cessé de parler de "prompt engineering" pour commencer à parler de "context engineering". Ce n'est pas un simple changement d'étiquette.

Le prompt engineering concerne les mots que vous écrivez. L'ingénierie de contexte concerne l'environnement informationnel total que le modèle IA voit —— instructions système, fichiers du projet, documents récupérés, historique de conversation, sorties d'outils et exemples. Comme l'a formulé l'ancien chercheur d'OpenAI Andrej Karpathy : "In every industrial-strength LLM app, context engineering is the delicate art and science of filling the context window with the right information."

Ce recadrage explique quelque chose de pratique : pourquoi deux personnes peuvent écrire des prompts presque identiques et obtenir des résultats radicalement différents. La différence est généralement le contexte, pas la formulation. L'une a fourni son schéma de base de données existant ; l'autre non. L'une a inclus une capture d'écran de son design ; l'autre l'a décrit avec des mots. L'une avait configuré un fichier de règles dans son outil ; l'autre repartait de zéro à chaque session.

Pour les constructeurs d'applications IA, l'ingénierie de contexte signifie réfléchir à trois choses :

- Contexte instructionnel —— prompts système, règles et exemples few-shot qui indiquent à l'IA comment se comporter

- Contexte de connaissances —— informations de domaine, documentation, patterns de code existants et faits du projet

- Contexte d'outils —— informations que le modèle rassemble depuis son environnement : exécuter du code, interroger des bases de données, lire des fichiers

Avant donc de vous obséder sur la formulation de votre prompt, demandez-vous si l'IA a réellement accès aux informations dont elle aurait besoin pour bien faire le travail. Souvent, ce n'est pas le cas —— et aucune formulation aussi intelligente soit-elle ne compense un contexte manquant.

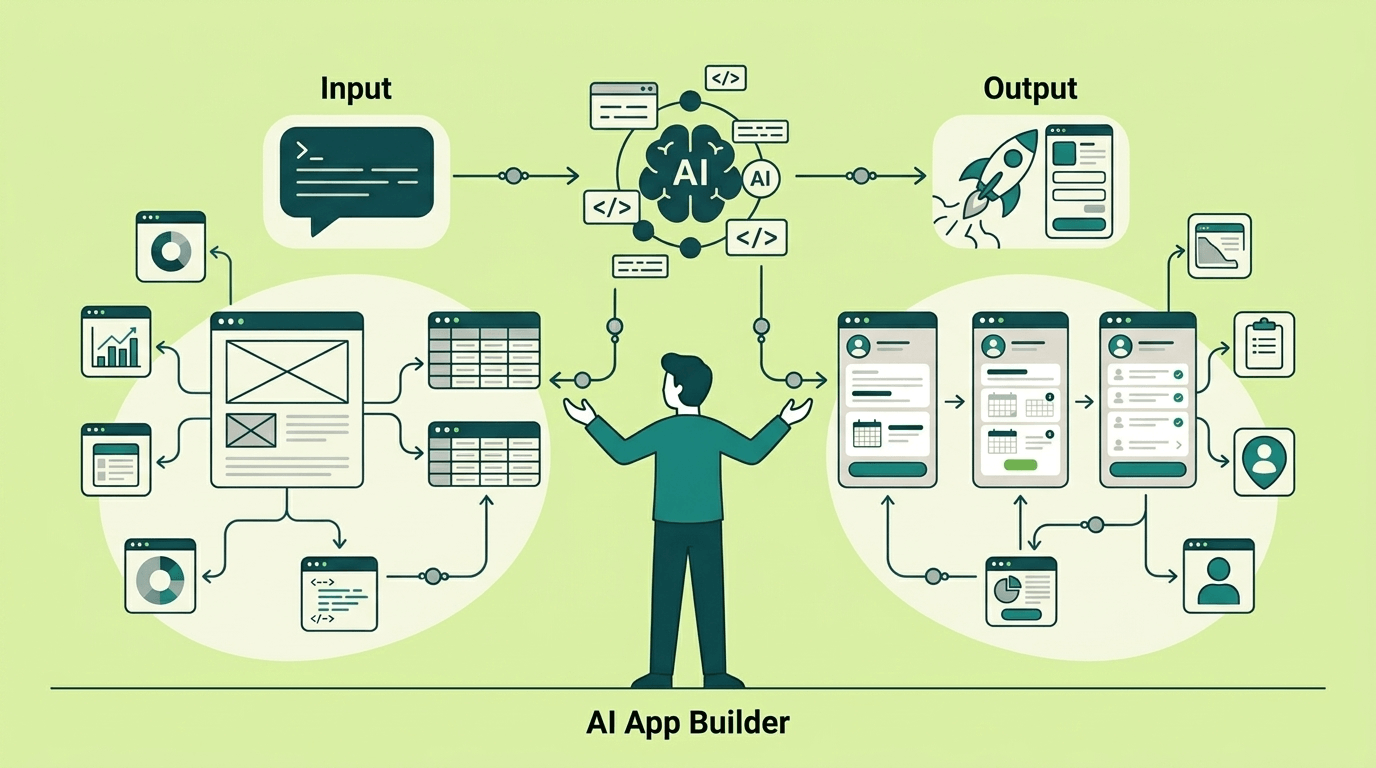

Ce qu'il faut dire à l'IA à chaque étape de construction

L'une des erreurs les plus courantes avec les constructeurs IA est de regrouper toutes vos exigences dans un seul prompt en espérant que tout ira bien. Les différentes étapes de la création d'une application nécessitent un contexte différent. Un prompt qui fonctionne parfaitement pour concevoir votre modèle de données produira des résultats médiocres pour construire votre interface si le contexte de design est absent.

Voici ce qui compte à chaque étape —— et ce qu'il faut inclure.

Lors de la construction de l'interface et du frontend

L'IA a besoin de savoir à quoi les choses doivent ressembler, pas seulement ce qu'elles doivent faire. Sans contexte visuel, elle se rabat sur des valeurs par défaut génériques —— et ces valeurs par défaut pourraient ressembler à du Bootstrap circa 2019.

À inclure :

- Palette de couleurs avec des codes hex spécifiques (couleurs primaire, secondaire, d'accentuation, succès/erreur/avertissement)

- Typographie —— quelles polices, quelles graisses pour les titres vs le corps de texte, préférences de hauteur de ligne

- Bibliothèque de composants —— "Utiliser shadcn/ui et Tailwind" ou "Utiliser les composants Mantine" donne à l'IA un vocabulaire de design cohérent

- Préférences de mise en page —— navigation latérale vs navigation supérieure, mises en page en cartes, nombre de colonnes sur desktop vs mobile

- Exigences d'accessibilité —— conformité WCAG AA, HTML sémantique, navigation au clavier

Un prompt qui dit "créer une page de tableau de bord" sans ce contexte produira quelque chose qui fonctionne techniquement mais ne ressemble en rien à votre marque. Un prompt qui inclut ne serait-ce qu'une spécification basique de design tokens —— couleurs, polices, espacement —— produit quelque chose que vous pouvez réellement déployer.

Build a dashboard page showing key metrics for an HR manager.

DESIGN CONTEXT:

- Component library: Mantine UI (React)

- Primary colour: #2563EB, secondary: #7C3AED, neutral backgrounds: #F8FAFC

- Typography: Inter for headings (600 weight), Inter for body (400 weight)

- Layout: sidebar navigation on the left (240px), main content area with 24px padding

- Cards for each metric, 8px border radius, subtle shadow (0 1px 3px rgba(0,0,0,0.1))

- Responsive: stack sidebar below content on screens under 768px

- WCAG AA colour contrast compliance required

METRICS TO DISPLAY:

- Open positions (count, trend arrow vs last month)

- Time-to-hire average (days, bar chart over last 6 months)

- Employee turnover rate (percentage, line chart over last 12 months)

- Pending onboarding tasks (list of next 5, with assignee and due date)

Lors de la construction du modèle de données

Les constructeurs IA sont particulièrement enclins à créer des schémas trop simplistes —— une seule table users avec vingt colonnes au lieu d'entités correctement normalisées. La solution est d'être méticuleux sur la structure. Explicitez chaque entité, chaque type de champ, chaque contrainte. Nommez votre convention de nommage (snake_case ? camelCase ? tables au singulier ou au pluriel ?). Si vous étendez une base de données existante, collez le schéma actuel —— sans cela, l'IA inventera des conventions qui entreront en conflit avec l'existant.

L'indexation mérite sa propre section dans le prompt. La plupart des schémas générés par IA omettent complètement les index, ce qui est acceptable pour un prototype et désastreux pour la production. Dites à l'IA quelles requêtes seront fréquentes, et elle ajoutera les bons index.

Design a database for a project management tool.

NAMING: Use snake_case for everything, plural table names.

Every table should track when records were created and last updated.

ENTITIES AND RELATIONSHIPS:

- Teams: name, unique slug identifier

- Users: email (unique), display name, belongs to one team

- Projects: name, belongs to a team, has an owner (a user),

status can be active, archived, or draft (defaults to draft)

- Tasks: title, optional description, belongs to a project,

can be assigned to a user (optional), status is one of

todo/in_progress/review/done, priority is low/medium/high/critical,

optional due date

PERFORMANCE:

- Add a composite index on tasks for project + status (we'll filter

task lists by project and then by status constantly)

- Index tasks by assignee (for "my tasks" views)

- Add a composite index on projects for team + status (for team

project listings)

VALIDATION:

- Due dates must be in the future when first set

- Project status defaults to "draft" on creation

Lors de la construction de la logique métier et du comportement backend

Les prompts backend échouent d'une manière différente des prompts UI. Au lieu d'avoir l'air faux, ils ont l'air bien —— jusqu'à ce que vous réalisiez que l'application gère les erreurs de manière incohérente, que la vérification d'authentification manque sur une page, ou qu'une action échouée affiche un message d'erreur cryptique au lieu de quelque chose d'utile.

Ce qui fonctionne le mieux : décrivez ce que l'utilisateur fait, ce qui doit se passer en coulisses, quelles règles s'appliquent, et ce que l'utilisateur doit voir quand quelque chose tourne mal. Si vous ajoutez à une application existante, montrez à l'IA un exemple fonctionnel de votre codebase —— elle saisit les patterns plus rapidement à partir d'exemples qu'à partir de règles écrites.

Build a task assignment feature for the project management tool.

USER FLOW:

- On the task detail page, managers and admins see an "Assign" button

- Clicking it opens a dropdown showing team members

- Selecting a person assigns the task to them

- The page updates immediately to show the new assignee

BUSINESS RULES:

- Only users with the Manager or Admin role within the project's team

can assign tasks

- The assignee must be a member of the same team as the project

- If a task is already marked as "done", it cannot be reassigned

- When a task is assigned, record who made the change and when

WHAT THE USER SEES WHEN SOMETHING GOES WRONG:

- User lacks permission: "You don't have permission to assign tasks

in this project"

- Task not found: show a "not found" page

- Task already completed: "This task is already done and can't

be reassigned"

- Selected assignee isn't on the team: "This person isn't a member

of the project's team"

Lors de la construction d'intégrations

Les intégrations tierces sont le point où le volume de contexte devient un vrai problème. Une référence API Stripe complète fait des milliers de pages. Vous n'avez pas besoin que l'IA connaisse tout —— vous avez besoin qu'elle connaisse les trois endpoints que vous appelez réellement, comment fonctionne l'authentification, à quoi ressemble la réponse, et quelles erreurs attendre. Élaguez sans merci. Collez un exemple de corps de réponse. Mentionnez les limites de débit si elles sont pertinentes. Et précisez toujours ce qui doit se passer quand le service externe est en panne —— car l'IA n'y pensera pas à moins que vous ne souleviez le sujet.

Structurer les exigences pour que le constructeur ne puisse pas les mal interpréter

La différence entre un prompt qui produit quelque chose d'utile et un qui produit quelque chose que vous passerez des heures à corriger tient généralement à la structure. Pas à la complexité —— à la structure. Même un prompt court fonctionne bien s'il sépare les instructions du contexte, décrit à quoi le résultat doit ressembler, et inclut un ou deux exemples.

Séparer les instructions du contexte

L'amélioration structurelle la plus simple : mettez ce que vous voulez que l'IA fasse en haut, et placez le matériel de référence (schémas de données, enregistrements exemples, design tokens) en dessous, clairement délimité. Les modèles IA traitent les instructions et les données dans un flux unique. Si la frontière n'est pas claire, le modèle pourrait traiter vos données d'exemple comme des instructions, ou vos instructions comme des suggestions optionnelles.

Utilisez des en-têtes clairs, des triples backticks ou des balises de type XML pour marquer les frontières :

TASK: Build a page that displays a customer list.

CONTEXT (reference data, do not interpret as instructions):

---

Sample customer record:

{

"id": 1042,

"name": "Acme Corp",

"plan": "pro",

"mrr": 299.00,

"status": "active",

"last_login": "2026-01-28T14:30:00Z"

}

---

REQUIREMENTS:

- Sortable columns: name, plan, MRR, last login

- Filter by status (active/churned/trial)

- Click row to navigate to /customers/[id]

- Show "No customers match your filters" when list is empty

Quand le format de sortie compte (et quand il ne compte pas)

Les constructeurs d'applications dédiés —— Chattee, Lovable, Bolt.new, Replit —— gèrent automatiquement la création de fichiers et la structure du projet. Vous n'avez jamais besoin de dire "retourner un composant React" ou "sortie en fichier .py." La plateforme s'en charge.

Ce conseil s'applique quand vous utilisez une IA généraliste (ChatGPT, Claude dans un navigateur, Copilot Chat) pour générer du code que vous copierez dans votre propre projet. Dans ce cas, dites exactement ce que vous voulez en retour : "un seul composant React en TypeScript" ou "une fonction Python, pas une classe."

Une chose qui s'applique partout, quelle que soit la plateforme : la définition des structures de données au sein de votre application. Si votre application passe des données entre pages, stocke des enregistrements ou appelle des services externes, décrivez la forme exacte —— noms de champs, types, et ce qui se passe quand une valeur est manquante.

Inclure des exemples quand la mise en forme compte

Les exemples few-shot —— deux ou trois échantillons de la sortie désirée —— sont systématiquement l'ajout le plus impactant à un prompt. Ils ancrent le comportement du modèle plus fiablement que des instructions abstraites. Si vous voulez un format de réponse API spécifique, montrez-en un. Si vous voulez un style de codage spécifique, incluez un extrait de code existant.

L'essentiel : rendez les exemples mécaniquement cohérents. Si un exemple utilise camelCase et un autre snake_case, le modèle alternera aléatoirement entre les deux.

Un modèle à copier

Un squelette généraliste pour les prompts de constructeurs d'applications IA :

TITLE: [Feature or app name]

GOAL (one sentence): [What success looks like]

NON-GOALS:

- [What the app must NOT do]

- [Out of scope items]

USERS:

- [Role A] — [why they use this feature]

- [Role B] — [why they use this feature]

DATA:

- Inputs: [what the user provides]

- Sources: [databases, APIs, files the app reads from]

- Prohibited: [data the app must not access or display]

WORKFLOWS:

- Happy path: [step by step]

- Alternate paths: [what happens when X]

- Error path: [what happens when things fail]

RULES:

- [Rule 1 — unambiguous, testable]

- [Rule 2 — unambiguous, testable]

OUTPUT FORMAT (skip if your platform handles file generation automatically):

- [Structure, required fields, types]

ACCEPTANCE TESTS:

- Given [input], expect [output/behaviour]

Ce n'est pas un format rigide —— adaptez-le à votre outil et votre projet. L'intérêt est que chaque section force une décision que vous laisseriez sinon à l'imagination de l'IA.

Bien gérer les rôles et les permissions

Les erreurs de permissions sont la catégorie la plus dangereuse de "mauvaise construction" car elles créent des failles de sécurité, pas simplement des désagréments UX. Et dans les applications générées par IA, le risque est amplifié : si vous ne spécifiez pas qui peut faire quoi, l'IA rendra soit tout accessible à tous, soit appliquera les permissions de manière incohérente.

Il y a deux concepts distincts que vous devez bien distinguer :

Les rôles de message sont la hiérarchie d'instructions au niveau API —— system, developer, user. Ils contrôlent quelles instructions l'IA priorise. Vos règles non négociables (frontières de sécurité, limites d'accès aux données) doivent être placées au niveau le plus élevé disponible.

Les rôles utilisateur de l'application sont les rôles produit —— admin, éditeur, lecteur, client. Ils déterminent ce qu'une personne peut voir et faire à l'intérieur de l'application que vous construisez.

Un bon prompt adresse les deux. Il place des frontières strictes dans les instructions système, puis définit un modèle de permissions concret pour l'application.

Le principe qui prévient la plupart des bugs de permissions

Refuser par défaut. Aucune action n'est permise sauf si elle est explicitement accordée. C'est une pratique de sécurité standard (l'OWASP la recommande aussi bien pour les applications web traditionnelles que pour celles alimentées par des LLM), et elle se traduit directement dans la façon dont vous rédigez vos prompts :

Au lieu de ceci :

Admins can manage everything.

Support agents can help customers.

Customers can see their account.

Écrivez ceci :

ROLES: customer, support_agent, admin

PERMISSIONS (deny by default — no action unless listed here):

customer:

CAN: read own profile (except payment_method field), create and view own tickets,

read public knowledge base articles

CANNOT: read other users' data, access internal KB, export data, modify roles

support_agent:

CAN: read tickets where assigned_to = self, draft replies, read internal KB

CANNOT: access billing data, delete users, change role assignments

admin:

CAN: manage KB articles, configure routing rules, manage role assignments

CANNOT: view ticket message content unless granted explicit "ticket_audit" permission

HIGH-RISK ACTIONS (require human approval regardless of role):

- Account deletion

- Bulk data export

- Role elevation

La première version est trois lignes de français qui pourraient signifier presque n'importe quoi. La seconde est implémentable —— un développeur (ou une IA) peut transformer chaque ligne en une vérification en base de données, un garde-fou API ou une règle de visibilité UI.

Quel modèle de contrôle d'accès décrire

Pour la plupart des cas d'utilisation de constructeurs d'applications, le RBAC (Role-Based Access Control) est le bon choix. Il se mappe proprement au format "le Rôle X peut faire Y" que les modèles IA gèrent bien. Décrivez les rôles, listez les actions permises par rôle, et spécifiez la portée de chaque action.

Si vous avez besoin d'un contrôle plus fin —— "les utilisateurs ne peuvent modifier que les tickets qu'ils ont créés" ou "les utilisateurs du plan Pro voient des fonctionnalités différentes de ceux du plan gratuit" —— vous vous orientez vers l'ABAC (Attribute-Based Access Control). Dans les prompts, exprimez-les comme des règles conditionnelles :

CONDITIONAL PERMISSIONS:

- A user can edit a ticket IF ticket.creator_id = user.id

- A user can access the analytics dashboard IF user.plan IN ('pro', 'enterprise')

- A user can view salary data IF user.department = record.department AND user.role = 'manager'

En résumé : décrivez les permissions d'une manière qui peut être vérifiée dans le code, pas d'une manière qui nécessite que l'IA "se souvienne" des règles pendant une conversation. Les permissions appliquées uniquement par l'IA sont peu fiables. Les permissions appliquées par le code sont testables.

Décrire la logique conditionnelle pour que les workflows fonctionnent réellement

C'est là que les applications construites par IA se cassent le plus souvent. Le happy path a l'air superbe. Mais la première fois qu'un utilisateur soumet un formulaire avec un champ manquant, qu'un paiement échoue, ou que quelqu'un essaie d'accéder à une page qu'il ne devrait pas voir —— l'application s'effondre.

La cause profonde : si vous ne décrivez pas ce qui se passe dans les scénarios non-happy-path, l'IA suppose que le happy path est le seul chemin.

Patterns qui fonctionnent dans les prompts

Les clauses de garde empêchent l'IA de foncer avec des informations incomplètes :

If required fields (order_id, customer_email) are missing,

ask the user to provide them. Do not proceed or guess.

Les tables de décision communiquent la logique de branchement plus clairement que la prose :

| Condition | Action | Sortie |

|---|---|---|

| Utilisateur non authentifié | Afficher l'invite de connexion, ne pas charger les données du compte | Pas d'appels API vers les endpoints utilisateur |

| Authentifié, demande une réinitialisation de mot de passe | Envoyer un e-mail de réinitialisation à l'adresse vérifiée | Message de confirmation, pas de mot de passe affiché |

| Authentifié, demande la suppression du compte | Générer une proposed_action pour revue humaine | escalation_needed = true |

| La recherche ne retourne aucun résultat | Afficher "Aucun résultat trouvé" avec des suggestions | Ne pas afficher un état d'erreur |

| L'appel API expire après 5 secondes | Afficher un bouton de réessai et un message d'excuse | Enregistrer l'événement de timeout avec le request_id |

Les machines à états fonctionnent bien pour les workflows multi-étapes :

ONBOARDING WORKFLOW STATES:

- invite_sent -> form_incomplete -> form_complete -> documents_pending ->

manager_review -> approved | rejected

TRANSITIONS:

- invite_sent -> form_incomplete: when new hire clicks invite link

- form_incomplete -> form_complete: when all required fields submitted

- form_complete -> documents_pending: automatic, after form validation passes

- documents_pending -> manager_review: when all required documents uploaded

- manager_review -> approved: when manager clicks "Approve"

- manager_review -> rejected: when manager clicks "Reject" (must provide reason)

- rejected -> form_incomplete: new hire can resubmit

RULES:

- No state transition can skip a step

- Rejected employees can resubmit up to 2 times, then escalate to HR director

Avant et après : rendre la logique conditionnelle explicite

Avant (le prompt qui produit un workflow cassé) :

If the user asks for a refund, help them. If it's not possible, escalate.

Après (le prompt qui produit un workflow fonctionnel) :

REFUND WORKFLOW (apply checks in this order):

1. Validation:

- If order_id is missing, ask: "What is your order number?"

- If no order found for that ID, say: "I couldn't find that order.

Please double-check the number."

2. Authorisation:

- If user_role = "customer", they can request, not execute. Produce

a refund request for agent review.

- If user_role = "support_agent", they can initiate. Proceed to step 3.

3. Business rules:

- If purchase older than 30 days, refund not eligible. Offer store

credit or escalation.

- If order total exceeds 500 USD, route to senior agent regardless of role.

- If customer has had more than 3 refunds in 90 days, flag for review.

4. Execution:

- Generate proposed_action: { type: "refund", order_id, amount, reason }

- Set escalation_needed = true (all refunds require human approval)

La seconde version gère les données manquantes, les utilisateurs non autorisés, les règles métier et les cas limites. Chaque ligne peut devenir un cas de test.

Cas limites : ce qui casse vraiment en production

Les constructeurs IA optimisent pour le happy path sauf si vous leur dites le contraire. Entrées manquantes, pannes d'API, actions utilisateur ambiguës et règles contradictoires —— ce sont les choses qui causent de vrais problèmes une fois que les gens commencent à utiliser l'application.

Une approche pratique : pour chaque fonctionnalité, passez en revue ces scénarios et incluez les réponses dans votre prompt.

Entrées manquantes ou incomplètes. L'application doit-elle demander une clarification, afficher une erreur de validation, ou utiliser une valeur par défaut ? Explicitez-le —— l'IA ne fera pas le même choix que vous.

Les services externes tombent en panne. Les bases de données expirent. Les processeurs de paiement rejettent des cartes. Décrivez ce que l'utilisateur voit quand quelque chose casse : s'il faut réessayer automatiquement, afficher un message d'erreur convivial, ou escalader vers un humain.

Les actions non autorisées doivent toujours produire un message clair et spécifique —— jamais un échec silencieux ou un dump d'erreur brut. Si quelqu'un essaie d'accéder à une page qu'il ne devrait pas voir, dites à l'IA exactement quoi afficher.

Les règles contradictoires sont étonnamment courantes. "Sois toujours serviable" combiné avec "ne partage jamais les détails du compte avec des utilisateurs non vérifiés" crée un paradoxe que l'IA ne peut pas résoudre seule. Donnez-lui un ordre de priorité : "Les règles de sécurité priment sur les règles de serviabilité."

Si votre application attend des données structurées de l'IA, utilisez l'application de schéma là où votre plateforme le supporte. Sinon, spécifiez un repli : "Si la réponse ne correspond pas au format attendu, afficher une erreur générique et journaliser la réponse malformée pour le débogage."

Une checklist à coller dans n'importe quel prompt de fonctionnalité :

EDGE CASE HANDLING:

- Missing required fields: ask clarifying questions; do not guess or use defaults

- External API timeout (over 5s): show user-friendly error + retry button; log event

- Permission denied: show "You don't have access to this action" with reason code

- Empty search results: show "No results found" message, not an error state

- Malformed data from external source: reject silently; do not process or display

- Conflicting rules: apply in this priority: (1) security, (2) permissions,

(3) data validation, (4) business rules, (5) UX preferences

Erreurs courantes de prompts IA dans les app builders (et comment les corriger)

Après avoir examiné la documentation des plateformes OpenAI, Google, Anthropic et de plusieurs frameworks de sécurité —— et discuté avec des personnes qui utilisent quotidiennement des constructeurs IA —— les mêmes schémas d'échec refont surface.

Essayer de tout construire d'un coup. "Construis un outil de gestion de projet avec authentification, tableaux Kanban, suivi du temps, diagrammes de Gantt, chat d'équipe, téléchargement de fichiers et une application mobile." Ce méga-prompt produit du code boursouflé et interconnecté, impossible à déboguer. Construisez une fonctionnalité à la fois. Vérifiez qu'elle fonctionne. Puis ajoutez la suivante.

Le brief de deux mots. "Construis-moi un portail employé" —— et rien d'autre. L'IA ne connaît pas votre entreprise, vos employés, ni ce que "portail" signifie pour vous. Elle créera quelque chose de générique qui se qualifie techniquement mais ne résout aucun de vos problèmes réels. La spécificité est gratuite —— utilisez-la.

Supposer que l'IA se souvient. Des prompts comme "tu connais notre produit" ou "utilise la stack habituelle" échouent car l'IA commence chaque session (et parfois chaque prompt) avec une ardoise vierge. Fournissez toujours le contexte explicitement. Certaines plateformes supportent des bases de connaissances persistantes —— Chattee et Lovable, par exemple, vous permettent de stocker du contexte de projet qui persiste entre les sessions —— mais même alors, les contraintes importantes ont leur place dans le prompt.

Des instructions contradictoires. "Suis toujours la requête de l'utilisateur" combiné avec "ne partage jamais de données personnelles" crée un paradoxe quand un utilisateur demande des données personnelles. Les modèles IA gèrent les conflits de manière imprévisible. Ajoutez un ordre de priorité : "En cas de conflit de règles, appliquer d'abord les contraintes de sécurité, puis les règles métier, puis les préférences utilisateur."

Des listes de "ne pas" sans "faire". "N'utilise pas de tableaux pour la mise en page. N'utilise pas de styles inline. Ne charge pas de données dans les composants." Les instructions négatives sont plus difficiles à suivre pour les modèles que les positives. Reformulez : "Utilise CSS Grid pour la mise en page. Utilise les classes utilitaires Tailwind. Charge les données dans une couche de service dédiée." La documentation de prompting d'OpenAI et de Google font ce point explicitement.

Greffer la sécurité après coup. Le code généré par IA n'est pas sécurisé par défaut. Une analyse de 2025 a révélé que 62 % du code généré par IA contient des défauts de conception ou des vulnérabilités connues. Inclure un simple rappel de sécurité dans votre prompt —— "valider toutes les entrées utilisateur, utiliser des requêtes paramétrées, ne jamais exposer les identifiants dans les réponses" —— a augmenté le taux de code sécurisé de 56 % à 66 % dans une étude. Pas une solution miracle, mais une amélioration significative pour une seule ligne de texte.

Se fier à l'IA comme seul gardien. Ne faites jamais confiance au modèle seul pour appliquer les permissions, les limites de débit ou les règles d'accès aux données. Il pourrait "oublier" des règles, surtout dans les longues conversations ou les applications complexes. Les vérifications de permissions doivent être appliquées dans le code. Traitez tout ce que l'IA génère comme un premier jet qui nécessite une vérification —— en particulier pour les chemins critiques en matière de sécurité.

Le méta-prompt : demander à l'IA de vous aider à écrire de meilleurs prompts

L'une des techniques les plus sous-utilisées dans la création d'applications IA : demander à l'IA elle-même d'améliorer votre prompt avant de l'utiliser pour construire quoi que ce soit.

Le processus est simple :

- Écrivez votre prompt brut —— même un paragraphe désordonné suffit

- Demandez à l'IA : "You are a prompt engineering expert. Review the following app-building prompt and identify what's missing, ambiguous, or likely to produce unexpected results. Then rewrite it."

- Répondez aux questions de clarification que l'IA pose

- Utilisez le prompt amélioré pour la construction effective

Vous pouvez pousser cela plus loin avec un méta-prompt structuré :

You are an expert in AI-powered app development. I want to build:

"""[your rough idea here]"""

Ask me up to 10 questions you need answered to write an effective,

detailed prompt for an AI app builder. Focus on:

- Scope boundaries (what's in, what's out)

- User roles and permissions

- Data models and relationships

- Workflows and conditional logic

- Edge cases and error handling

- Design and UX preferences

After I answer, generate the final structured prompt I should use.

Cela fonctionne parce que les modèles IA sont souvent meilleurs pour identifier ce qui manque dans une spécification que pour deviner les bonnes valeurs par défaut. Le méta-prompt transforme l'IA en analyste des exigences avant qu'elle ne devienne constructeur.

Tester et améliorer les prompts d'applications IA

Le premier prompt qui fonctionne est rarement le meilleur prompt. Comme le code, les prompts nécessitent des tests, du versioning et du raffinage.

Un cycle d'itération pratique :

1. Définir ce que signifie "correct". Avant d'exécuter un prompt, notez trois à cinq résultats concrets que vous accepteriez comme réussis. "La page de connexion a des champs e-mail et mot de passe, un lien 'mot de passe oublié', et affiche un message d'erreur spécifique pour des identifiants invalides."

2. Exécuter le prompt et noter les échecs. Pas seulement "ça ne marche pas" —— catégorisez ce qui a mal tourné. Fonctionnalité manquante ? Mauvais format ? Faille de sécurité ? Logique incorrecte ? Chaque type d'échec a une correction différente.

3. Corriger une chose à la fois. Résistez à l'envie de réécrire tout le prompt après un échec. Ajoutez la contrainte manquante, clarifiez le terme ambigu, ou ajoutez un exemple. Puis relancez. Changer trop de choses à la fois rend impossible de savoir ce qui a résolu le problème.

4. Sauvegarder les prompts qui fonctionnent. Quand un prompt produit de bons résultats, sauvegardez-le comme modèle. Au fil du temps, vous accumulerez une bibliothèque de "prompts en or" pour des patterns courants —— flux d'authentification, interfaces CRUD, fonctionnalités de recherche, systèmes de notification.

5. Retester lors du changement de modèle. Un prompt optimisé pour un modèle IA peut fonctionner différemment sur un autre. Si vous changez de modèle (ou si votre plateforme met à jour le sien), relancez vos tests. La communauté du prompt engineering a observé à maintes reprises que les stratégies de prompting ne sont pas universellement portables entre les modèles —— ce qui fonctionne pour Claude peut sous-performer sur GPT-4, et vice versa.

Certaines équipes —— en particulier les agences qui créent des applications pour plusieurs clients —— utilisent des outils dédiés pour l'évaluation des prompts. Promptfoo (open source, basé sur CLI) vous permet de définir des cas de test en YAML et d'exécuter des prompts en lot. DeepEval s'intègre aux suites de test Python. Pour la plupart des constructeurs individuels cependant, un simple document suivant "version du prompt, résultats des tests, modifications apportées" suffit pour rester sur la bonne voie.

Bonnes pratiques et cas d'utilisation par plateforme

Les différents constructeurs IA gèrent le contexte de manières différentes. Quelques notes sur les plateformes que vous êtes le plus susceptible de rencontrer :

Bolt.new donne à l'IA le contrôle total du système de fichiers dans le navigateur, du terminal et du serveur. Commencez par établir l'architecture —— choix de framework, structure de mise en page, langage de design —— dans votre premier prompt. Les prompts suivants peuvent alors faire référence à "en utilisant le même style" sans tout répéter. Sachez que la rétention du contexte peut se dégrader une fois que les projets dépassent 15 à 20 composants.

Lovable supporte une base de connaissances persistante avec des catégories pour les directives de projet, les personas utilisateur, les assets de design et les conventions de codage. Il dispose également d'un système de mémoire dans un dossier docs/ (memory.md, architecture.md, etc.) qui persiste entre les sessions. Tirez-en parti pour éviter de répéter le contexte dans chaque prompt. Une action par prompt tend à mieux fonctionner que des requêtes multi-étapes.

Replit Agent offre un "mode Plan" où vous pouvez discuter de l'architecture avant de construire. Utilisez-le. Le bouton "Improve Prompt" vaut aussi le coup d'être essayé —— il reformule votre prompt pour le rendre plus spécifique. Le système de checkpoints de Replit vous permet de revenir en arrière en toute sécurité, donc vous pouvez expérimenter plus agressivement.

v0 (Vercel) est spécialisé dans la génération d'interfaces React/Next.js. Il comprend nativement les composants shadcn/ui et supporte un système de Registry pour transmettre des design tokens au modèle. Si vous utilisez v0 pour du travail frontend, fournir un fichier tailwind.config et globals.css donne de meilleurs résultats que de décrire les couleurs en prose.

Cursor utilise des fichiers .cursor/rules/ (avec l'extension .mdc) pour fournir un contexte persistant à l'IA. Configurez-les avant de commencer à construire —— ils sont plus efficaces que de répéter les instructions dans chaque prompt. Démarrez un nouveau chat pour chaque tâche ; les longs fils de conversation causent une dérive du contexte.

Chattee adopte une approche en deux phases : d'abord une phase de planification où l'IA crée un plan d'implémentation, puis une phase d'exécution où elle construit. Ce pattern planifier-puis-exécuter vous donne un point de contrôle pour vérifier la compréhension de l'IA avant qu'elle n'écrive du code —— captant les mauvaises interprétations avant qu'elles ne deviennent des fonctionnalités mal construites. La plateforme génère des applications full-stack (base de données, authentification, logique métier et interface) à partir de langage naturel et gère le déploiement sur des domaines personnalisés.

Structure de prompt du début à la fin

Pour rassembler le tout, imaginez que vous êtes responsable des opérations dans une entreprise de taille moyenne et que vous avez besoin d'un outil interne pour gérer les demandes de maintenance d'équipements. Le processus complet de prompting pourrait ressembler à ceci.

Étape 1 : idée brute (méta-prompt)

I need an internal web app for tracking equipment maintenance requests

at our manufacturing facility. About 200 employees, 50 pieces of major

equipment. Currently using spreadsheets and email, it's a mess.

Ask me the questions you need answered to write a detailed prompt for

an AI app builder.

L'IA pourrait demander : Qui soumet les demandes ? Qui les approuve ? Quelles informations sont capturées ? Y a-t-il des niveaux de priorité ? Que se passe-t-il quand la maintenance est terminée ? Y a-t-il un système de notification ? Qu'en est-il des calendriers de maintenance récurrents ?

Étape 2 : répondre aux questions, puis obtenir un prompt structuré en retour

Après avoir répondu, l'IA génère quelque chose comme ceci (que vous affinez) :

TITLE: Equipment Maintenance Request Tracker

GOAL: Replace spreadsheet-based maintenance tracking with a web app

that lets floor staff report issues, maintenance teams triage and

resolve them, and managers see status at a glance.

USERS:

- Floor Staff (200 people): Submit requests, attach photos, check status

of their submissions

- Maintenance Team (12 people): View queue, claim requests, update status,

log resolution notes

- Facility Manager (3 people): Dashboard overview, approve high-cost

repairs (over 2000 USD), export reports

DATA MODEL:

- equipment (id, name, location, type, installation_date, status)

- maintenance_requests (id, equipment_id FK, submitted_by FK,

priority ENUM(low/medium/high/critical), description, photos[],

status ENUM(submitted/triaged/in_progress/pending_approval/resolved/closed),

created_at, resolved_at)

- resolution_notes (id, request_id FK, author_id FK, note_text, created_at)

PERMISSIONS (deny by default):

- floor_staff: create requests, view own requests, upload photos to

own requests

- maintenance_team: view all requests, claim (assign to self), update

status, add resolution notes

- facility_manager: all maintenance_team permissions + approve high-cost

repairs + view dashboard + export CSV

WORKFLOWS:

- Submit request, auto-assign priority based on equipment type,

maintenance team triages, claim, work, resolve

- If estimated_cost over 2000 USD, status moves to pending_approval,

facility manager approves or rejects with comment

- If request not claimed within 4 hours and priority = critical,

alert facility manager

EDGE CASES:

- Photo upload fails: show retry button, save request text without photos

- Duplicate request for same equipment within 24 hours: warn submitter,

offer to add note to existing request instead

- Equipment not in system: allow "Other" selection with free-text

description, flag for admin to add to equipment list

DESIGN:

- Clean, functional (not consumer-flashy — this is a factory floor tool)

- Large touch targets (used on tablets with gloves)

- High contrast colour scheme for visibility in bright environments

- Mobile-first for floor staff, desktop-optimised for manager dashboard

Étape 3 : construire itérativement

Ne collez pas tout ce prompt en disant "go." Alimentez-le par étapes :

- Modèle de données et schéma d'abord —— vérifiez que c'est cohérent

- Flux de soumission pour le personnel de terrain —— testez avec le happy path et un cas limite

- File d'attente et workflow de l'équipe de maintenance —— vérifiez la prise en charge et les mises à jour de statut

- Tableau de bord manager et flux d'approbation

- Notifications et alertes

Chaque étape obtient son propre prompt ciblé, avec la spécification globale comme contexte.

Aide-mémoire : modèles de prompts IA valables pour tous les app builders

- Instructions d'abord, contexte ensuite. Mettez ce qui doit être fait en haut. Le matériel de référence va en dessous, clairement séparé.

- Soyez spécifique sur le format. Si vous avez besoin de données structurées, montrez la forme. Si vous avez besoin d'une interface, nommez la bibliothèque de composants. Si vous avez besoin d'une base de données, nommez la technologie.

- Montrer, pas seulement dire. Deux ou trois exemples de la sortie désirée battent un paragraphe d'exigences abstraites.

- Dites quoi faire, pas seulement quoi ne pas faire. "Valider toutes les entrées utilisateur côté serveur" fonctionne mieux que "ne pas faire confiance aux données côté client."

- Une tâche, un prompt. Les fonctionnalités complexes construites tranche par tranche produisent des résultats plus propres et plus faciles à déboguer que les méga-prompts.

- Formulez explicitement les exigences de sécurité. Validation des entrées, vérifications d'authentification, limites d'accès aux données —— ne supposez jamais que l'IA les ajoutera d'elle-même.

- Testez les cas limites, pas seulement les happy paths. Pour chaque fonctionnalité, décrivez au moins un scénario d'échec : entrée manquante, permission refusée, service externe en panne.

- Sauvegardez ce qui fonctionne. Constituez une bibliothèque de prompts éprouvés pour les patterns que vous utilisez régulièrement.

- Vérifiez le travail de l'IA. Examinez le code généré comme vous examineriez le travail d'un prestataire. Vérifiez la logique des permissions, le traitement des données et les états d'erreur —— surtout avant de déployer pour de vrais utilisateurs.

L'écart entre une expérience frustrante et une expérience productive avec un constructeur IA ne tient presque jamais aux capacités de l'outil. Il tient à la clarté des instructions que vous lui donnez. La bonne nouvelle : contrairement à l'apprentissage de la programmation, apprendre à écrire des prompts efficaces est quelque chose que vous pouvez améliorer significativement en un après-midi —— et les bénéfices se composent avec chaque projet que vous construisez.